Vì sao trí tuệ nhân tạo là "con dao 2 lưỡi"?

Thế giới đang hưởng lợi lớn từ sự phát triển của trí tuệ nhân tạo (AI). Thế nhưng, nếu không được sử dụng đúng cách, AI sẽ mang tới những mối nguy ảnh hưởng trực tiếp tất cả mọi người.

Châu Á trong cơn sốt trí tuệ nhân tạo

Khu vực Châu Á - Thái Bình Dương đang đi đầu trong cuộc cách mạng về AI. Quy mô thị trường AI tại khu vực Châu Á - Thái Bình Dương hiện ở mức 22,1 tỷ USD và dự kiến sẽ tăng gần gấp 4 lần vào năm 2028, lên thành 87,6 tỷ USD.

Một nghiên cứu gần đây của IDC tiết lộ, chi tiêu cho trí tuệ nhân tạo tại khu vực Châu Á - Thái Bình Dương sẽ tăng gấp đôi sau ba năm, từ 9,8 tỷ USD vào năm 2023 lên 18,6 tỷ USD vào năm 2026.

Trong đó, thị trường Trung Quốc đang dẫn đầu về khả năng thích ứng công nghệ AI với tốc độ tăng trưởng lên đến 27,9% mỗi năm trong giai đoạn 2021 – 2026. Australia đứng thứ 2 trong khu vực với ngân sách dành cho AI ước tính khoảng 6,4 tỷ USD năm 2026. Trong khi đó, Ấn Độ sẽ đứng thứ 3 về mức chi tiêu với ngân sách khoảng 3,6 tỷ USD cho AI.

Chia sẻ tại hội nghị Cyber Security Weekend hiện đang được tổ chức, ông Adrian Hia, Giám đốc điều hành khu vực Châu Á - Thái Bình Dương của Kaspersky cho hay, trí tuệ nhân tạo đã có rất lâu trước đây, từ thời của nhà bác học lừng danh Alan Turing. Thế nhưng giờ mới là thời điểm mà công nghệ này chi phối và tham gia sâu hơn vào cuộc sống thường ngày.

Lý giải về sự đầu tư mạnh mẽ cho AI của các quốc gia châu Á, theo ông Adrian Hia, các công ty trong khu vực nhận thức được việc công nghệ này sẽ giúp tăng hiệu quả quản lý tài sản, cải thiện chất lượng sản phẩm và thậm chí hợp lý hóa chuỗi cung ứng để từ đó mang lại lợi nhuận tốt hơn.

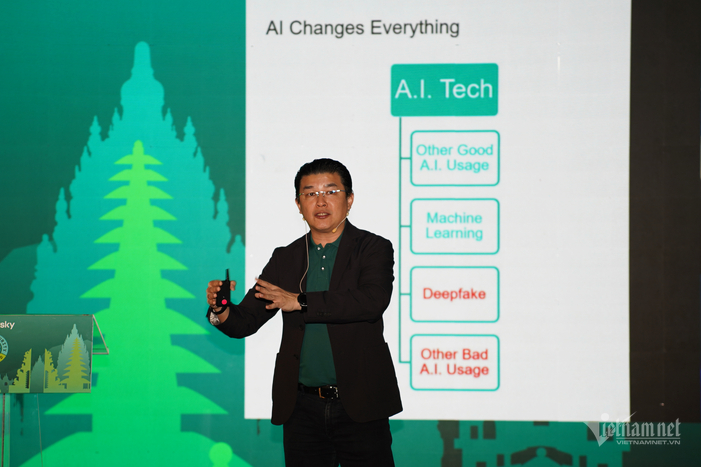

Từ câu chuyện của ChatGPT, ai cũng có thể thấy sự thần kỳ của trí tuệ nhân tạo, khi mà máy tính có thể tự động tổng hợp và làm mọi thứ, trả lời mọi loại câu hỏi. Tuy vậy, theo chuyên gia của Kaspersky, AI hiện đang được ứng dụng vào nhiều mục đích khác nhau, trong đó có cả mục đích tốt và xấu. Đó là lý do chúng ta phải đối mặt với ngày một nhiều hơn các vụ tấn công lừa đảo bằng Deepfake, chỉnh sửa khuôn mặt, giọng nói và nhiều thể loại tấn công mạng khác nữa.

Đâu là mặt trái của trí tuệ nhân tạo?

Theo chuyên gia bảo mật Noushin Shabad, bên cạnh các vụ lừa đảo kiểu Deepfake, AI có thể bị lạm dụng để thực hiện các vụ tấn công mạng, đặc biệt trong việc dùng chúng để tạo ra các công cụ như mã độc (malicious code) hoặc phần mềm độc hại (malware).

“Ngoài việc phát triển phần mềm độc hại, AI còn có thể được sử dụng trong nhiều giai đoạn khác nhau của một cuộc tấn công mạng tinh vi. Khi các hacker kết hợp nhiều kỹ thuật phức tạp để tránh bị phát hiện, họ sẽ sử dụng trí tuệ nhân tạo trong nhiều vai trò khác nhau, từ việc thăm dò cho đến đánh cắp dữ liệu”, chuyên gia Noushin Shabad nói.

Đó chưa phải là toàn bộ mặt trái của AI. Chia sẻ tại Cyber Security Weekend, ông Vitaly Kamluk, Giám đốc Nhóm Nghiên cứu và Phân tích toàn cầu (GReAT) khu vực Châu Á - Thái Bình Dương của Kaspersky tiết lộ, AI đã và đang tác động trực tiếp tới tâm lý của giới tội phạm mạng.

Khi thực hiện hành vi tấn công hoặc làm bị thương người khác, kẻ phạm tội thường sẽ chịu áp lực tâm lý nặng nề từ việc chứng kiến trực tiếp hậu quả mà chúng gây ra. Tuy nhiên, điều này không còn đúng với tội phạm mạng khi chúng đánh cắp và tấn công một nạn nhân mà chẳng bao giờ nhìn thấy họ, đặc biệt nhờ sự trợ giúp của trí tuệ nhân tạo.

Cụ thể hơn, khi tội phạm mạng sử dụng AI để thực hiện hành vi phạm tội, chúng có thể đổ lỗi cho công nghệ này và cảm thấy ít phải chịu trách nhiệm hơn về hậu quả mà cuộc tấn công mạng gây ra.

Theo Vitaly Kamluk, việc sử dụng AI để thực hiện hành vi phạm pháp mang lại tiền bạc, lợi ích một cách thần kỳ, nhanh chóng cho kẻ phạm tội. Điều này khiến giới tội phạm không còn cảm thấy tội lỗi bởi trên thực tế, AI mới là chủ thể trực tiếp gây ra hành vi phạm pháp.

Không chỉ những kẻ phạm tội, chính các chuyên gia bảo mật cũng sẽ nảy sinh tâm lý “ủy thác trách nhiệm” cho AI khi ngày càng nhiều quy trình và công cụ an ninh mạng được tự động hóa và trao quyền cho trí tuệ nhân tạo.

Sự phát triển quá nhanh của trí tuệ nhân tạo, đặc biệt sau trào lưu ChatGPT khiến giới bảo mật đau đầu về việc làm sao để phát huy được hết những ưu điểm của công nghệ này, trong khi vẫn đảm bảo được vấn đề an toàn an ninh mạng.

Theo ông Eugene Kaspersky, Giám đốc điều hành của Kaspersky, trong thời đại mà người tốt cũng như kẻ xấu đều có thể sử dụng công nghệ, an ninh mạng truyền thống không còn đủ khả năng bảo vệ nữa. Chúng ta cần cách mạng hóa hệ thống phòng thủ để đảm bảo tạo ra một thế giới kỹ thuật số an toàn hơn.