Cuộc đua quản lý công nghệ trí tuệ nhân tạo (AI) đang ngày càng nóng hơn bao giờ hết, trong bối cảnh AI phát triển vượt bậc, mang lại nhiều tiện ích cho cuộc sống con người nhưng cũng dẫn tới nhiều nguy cơ và thách thức về độ an toàn đối với người dùng và người quản lý.

Bên cạnh đó, cuộc đua làm chủ AI giữa các tập đoàn công nghệ và các cường quốc đi đầu cũng tạo ra động lực thúc đẩy chính phủ các nước, các thể chế quốc tế tìm ra giải pháp kiểm soát AI trên phạm vi toàn cầu.

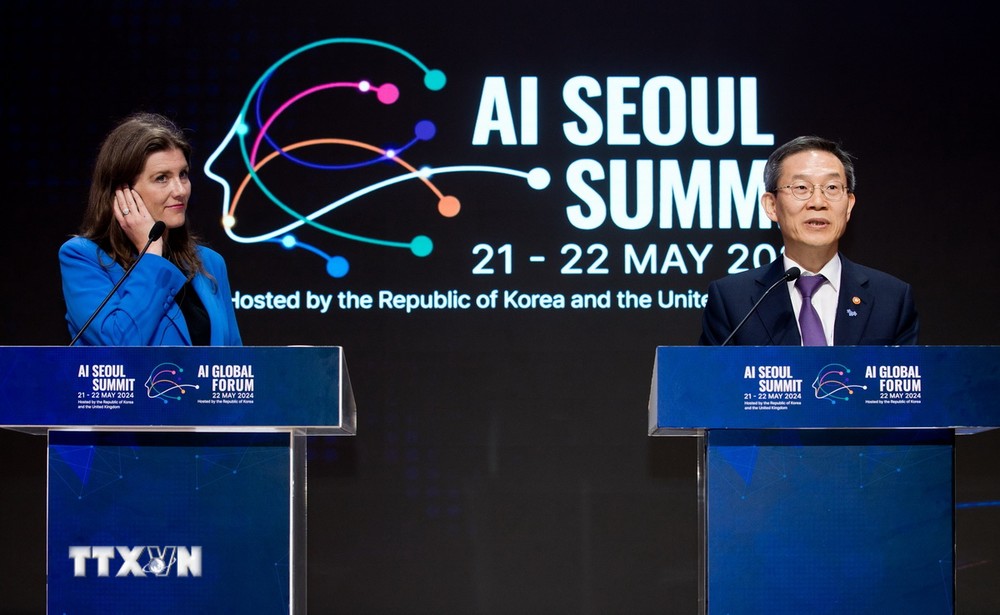

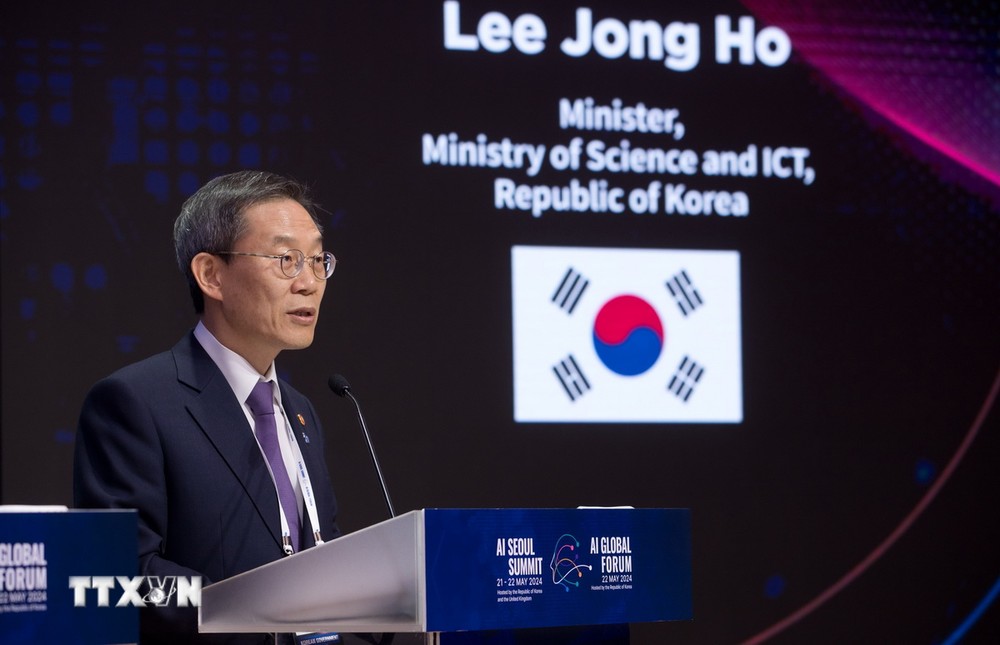

Việc Thủ tướng Anh Rishi Sunak và Tổng thống Hàn Quốc Yoon Suk Yeol đồng chủ trì phiên họp trực tuyến của các nhà lãnh đạo tại Hội nghị thượng đỉnh toàn cầu về AI, diễn ra tuần này tại Seoul (Hàn Quốc), đã cho thấy tầm quan trọng của vấn đề quản lý AI hiện nay.

Hội nghị với chủ đề “Xây dựng dựa trên Hội nghị thượng đỉnh an toàn AI: Hướng tới một tương lai đổi mới và toàn diện” do Hàn Quốc và Anh đồng tổ chức, tập trung vào các nguyên tắc quản trị AI toàn cầu nhằm thúc đẩy sự đổi mới, an toàn và tính toàn diện; thúc đẩy đổi mới, trong đó có việc nghiên cứu AI tại các trường đại học, xem xét các cách để đảm bảo công nghệ này được mở rộng cho tất cả mọi người và hỗ trợ giải quyết các vấn đề như biến đổi khí hậu và nghèo đói.

Sự kiện được xem là bước tiếp nối thành công của Hội nghị thượng đỉnh về an toàn AI toàn cầu đầu tiên,diễn ra tại Bletchley Park (Anh) hồi năm ngoái - nơi hàng chục chính phủ các nước, công ty AI, giới nghiên cứu đã đạt được "Tuyên bố Bletchley" cam kết quốc tế đầu tiên về quản lý AI.

Vấn đề đảm bảo an toàn AI đã được đưa lên hàng đầu trong chương trình nghị sự và là kết quả nổi bật của hội nghị Seoul, với tuyên bố về AI an toàn, sáng tạo và toàn diện nhằm giải quyết những thách thức và cơ hội liên quan đến quá trình thiết kế, phát triển, triển khai và sử dụng của công nghệ AI tiên tiến.

"Tuyên bố Seoul" nhấn mạnh công ty AI sẽ công khai cách thức họ đánh giá rủi ro của công nghệ AI, trong đó có việc xác định những rủi ro nào được coi là "không thể chấp nhận được" và các biện pháp để đảm bảo những rủi ro này không vượt ngưỡng cho phép.

Trong trường hợp xấu nhất, các công ty cam kết sẽ không phát triển hoặc triển khai mô hình hoặc hệ thống nếu không thể giảm thiểu rủi ro xuống dưới mức cho phép.

Định nghĩa về ngưỡng này sẽ được quyết định trước hội nghị thượng đỉnh AI tiếp theo, dự kiến diễn ra tại Pháp vào năm 2025.

Đáng chú ý, hơn 16 công ty hàng đầu thế giới về AI, trong đó có OpenAI (nhà phát triển ChatGPT), Google DeepMind, Anthropic, Microsoft, Amazon, IBM, Meta, Mistral AI (Pháp) và Zhipu.ai (Trung Quốc), đã đưa ra cam kết mới về an toàn.

Đây là bước tiếp theo sau sự đồng thuận đạt được tại hội nghị ở Bletchley Park.

Có thể nói, từ hội nghị thượng đỉnh đầu tiên ở Bletchley đến hội nghị Seoul mới chỉ hơn 6 tháng, nhưng thế giới đã chứng kiến những bước tiến dài trong quản trị AI toàn cầu.

Với thành công của Hội nghị Bletchley và sau một năm 2023 bùng nổ, AI trở thành chủ đề thảo luận quan trọng tại các hội nghị quốc tế, các bài phát biểu của chính khách, diễn ngôn chính sách ở nhiều diễn đàn khác nhau và AI cũng là một trong những từ khóa được nhắc đến nhiều nhất trên các phương tiện thông tin đại chúng, nền tảng mạng xã hội.

Nhiều nước trên thế giới, không kể giàu nghèo, đều cố gắng tích hợp việc phát triển và quản lý AI vào các chiến lược, chính sách phát triển kinh tế xã hội quốc gia.

Các công ty AI phát triển nhanh chóng, ngày càng trở thành thế lực chi phối ngành công nghệ thế giới. Sự phát triển nhanh chóng và ứng dụng rộng rãi AI đã mang lại doanh thu hàng nghìn tỷ USD cho các công ty công nghệ, trong đó nổi bật là các ông lớn như Meta, Amazon, Apple, Alphabet, Microsoft …

Đối với một số công ty công nghệ, doanh thu tăng giúp đẩy giá cổ phiếu tăng vọt. Trong báo cáo kết quả quý 4/2023, Nvidia cho biết AI đã giúp nâng giá trị của công ty này lên đến 2.000 tỷ USD.

Các công ty lớn ngày càng đầu tư mạnh tay cho AI, tuyển dụng các nhóm chuyên gia và mua sắm trang thiết bị cần thiết. Một số "ông lớn" đang thử nghiệm các phương pháp sử dụng AI hiệu quả, tuyển dụng hàng nghìn chuyên gia AI.

Sau Hội nghị Bletchley với Tuyên bố chung được 27 nước và Liên minh châu Âu (EU) ký kết, các chính phủ và tổ chức quốc tế cũng như khu vực đã có những bước tiến quan trọng trong hoạch định chính sách để quản lý AI.

Nhiều sáng kiến pháp lý và dự luật mới đã được giới thiệu, với vai trò dẫn dắt của EU và Mỹ. EU đã thông qua luật quản lý AI, là quy định toàn diện đầu tiên trên thế giới về quản lý AI, đóng vai trò là khuôn mẫu toàn cầu cho các quốc gia khác noi theo.

Nhiều nước, trong đó có Mỹ và Trung Quốc, Brazil, Nhật Bản, cũng như các tổ chức toàn cầu như Liên hợp quốc và Nhóm các nước công nghiệp phát triển (G7), cũng đang xúc tiến xây dựng các quy định về quản lý AI.

Tháng 3 vừa qua, Đại hội đồng Liên hợp quốc thông qua nghị quyết đầu tiên về thúc đẩy các hệ thống AI “an toàn, bảo mật và đáng tin cậy" để phục vụ cho mục tiêu phát triển bền vững.

Nghị quyết đánh dấu thời điểm AI trở thành một chủ đề thảo luận thực chất ở tầm toàn cầu và bảo đảm vị thế bình đẳng cho các quốc gia trong thảo luận cũng như tiếp cận công nghệ AI.

Trao đổi với phóng viên TTXVN tại Anh, một chuyên gia nghiên cứu về AI tại công ty Amazon nhận định rằng kết quả hội nghị thượng đỉnh Seoul và những bước phát triển mạnh mẽ của AI thời gian qua cho thấy phát triển “AI có trách nhiệm” sẽ tiếp tục là xu hướng chủ đạo, lâu dài và bền vững.

Phát triển “AI có trách nhiệm” là vấn đề nghị sự toàn cầu, thu hút sự quan tâm của các quốc gia trên thế giới vì đây là vấn đề liên quan đến sự phát triển của con người, của quốc gia và nhân loại.

Đối với Anh, việc hoạch định chính sách phát triển “AI có trách nhiệm” được chú trọng ở tất cả các khâu, từ chính sách quản lý, đầu tư, cấp vốn cho doanh nghiệp khởi nghiệp…, song quản lý hoạt động của các doanh nghiệp lớn có ứng dụng AI (Google, Amazon…) vẫn là bài toán khó.

Đây cũng là lý do khiến các công ty này có mặt tại các hội nghị để có thể thảo luận, tham gia hoạch định chính sách phát triển và quản lý AI cùng với chính phủ và các tổ chức quốc tế.

Trên thực tế, việc ứng dụng “AI có trách nhiệm” còn khó khăn vì chưa thể định nghĩa rõ “AI có trách nhiệm” là gì, nội dung như thế nào và điều này đòi hỏi phát triển kỹ thuật mới, thu thập dữ liệu huấn luyện, phương pháp đánh giá phù hợp.

Ngoài ra, việc chú trọng phát triển “AI có trách nhiệm” hiển nhiên sẽ làm chậm phát triển AI nói chung, nên cần phải có sự đồng thuận của nhiều nước và các tập đoàn lớn về công nghệ.

Hiện các tập đoàn lớn và các nước vẫn đang chạy đua, cạnh tranh quyết liệt về AI, nên không ai muốn chậm lại để rồi tụt lại phía sau.

Đối với các nước đang phát triển, trong đó Việt Nam, việc phát triển và ứng dụng “AI có trách nhiệm” cũng sẽ đối mặt với nhiều thách thức liên quan tới bài toán lợi nhuận với các tập đoàn và ưu thế công nghệ của các nước lớn.

Mặc dù phát triển AI không khó về mặt phương pháp, kỹ thuật vì ngày càng có nhiều nguồn mở, song các nước như Việt Nam còn hạn chế về nền tảng như hạ tầng tính toán (GPU, storage), dữ liệu lớn (big data), nguồn nhân lực chất lượng và năng lượng.

Bên cạnh đó là các thách thức pháp lý như: địa vị pháp lý của AI? trách nhiệm pháp lý trong ứng dụng AI (dân sự, hình sự, hành chính); Bảo vệ dữ liệu cá nhân trong ứng dụng AI; Quyền sở hữu trí tuệ trong ứng dụng AI. Đây sẽ là những vấn đề các nước phải giải quyết trong thời gian tới để ứng dụng AI thực sự hiệu quả và có trách nhiệm.

Từ nền tảng của Tuyên bố Bletchley, những hội nghị thượng đỉnh AI toàn cầu sẽ là cơ hội để cộng đồng quốc tế chia sẻ kinh nghiệm và tiếp tục tạo thêm những bước tiến trong lĩnh vực quản lý AI./.