Bộ Công an cảnh báo hành vi ghép mặt, giả giọng nói để lừa đảo

Bộ Công an vừa có văn bản cảnh bảo về hành vi lừa đảo qua mạng internet bằng trí tuệ nhân tạo (AI). Bọn tội phạm thường cắt ghép hình ảnh, giọng nói để lừa đảo chiếm đoạt tài sản người dân. Hình thức lừa đảo mới này gây hoang mang dư luận, làm ảnh hưởng lớn đến tình hình an ninh trật tự, an toàn xã hội.

Theo Bộ Công an, gần đây, các đối tượng tội phạm đã chuyển sang hình thức lừa đảo bằng tìm việc làm online tại nhà, tham gia chứng khoán, mua tiền ảo, nợ tiền điện thoại, con bị tai nạn, chuyển đổi sim điện thoại…

Bọn tội phạm sử dụng những hình ảnh cắt ghép, đưa các quyết định tố tụng giả của các cơ quan chức năng lên mạng hù dọa để các bị hại sợ, tin, buộc phải chuyển tiền cho chúng.

Loại tội phạm này gây rất nhiều khó khăn trong công tác điều tra, truy vết của lực lượng chức năng. Vì chúng không chỉ nằm ở trong nước mà còn ở ngoài lãnh thổ Việt Nam.

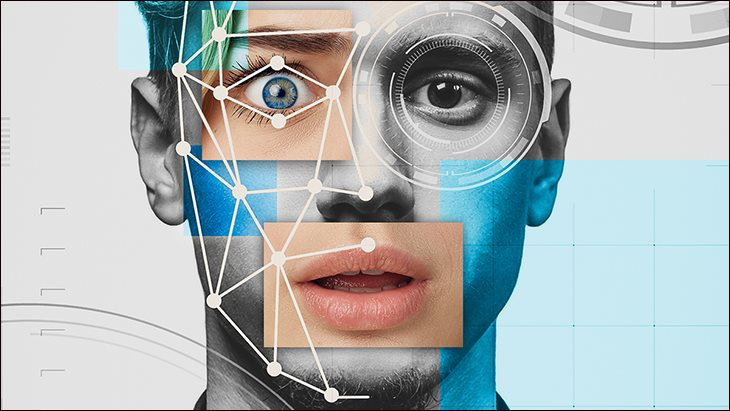

Nguy hiểm hơn các đối tượng còn sử dụng công nghệ Deepfake (là công nghệ ứng dụng trí tuệ nhân tạo AI) vào mục đích lừa đảo, chiếm đoạt tài sản.

Deepfake là phương thức sử dụng trí tuệ nhân tạo (AI) để tạo ra các sản phẩm công nghệ giả dưới dạng âm thanh (giọng nói) hình ảnh (khuôn mặt).

Thậm chí, chúng tạo ra giả giọng nói, khuôn mặt người quen của bị hại trên mạng xã hội rồi tương tác. Khi chiếm được lòng tin, các đối tượng yêu cầu bị hại thực hiện các giao dịch tài chính như: vay tiền, chuyển tiền giúp con đi học,… để lừa đảo, chiếm đoạt tài sản.

Các đối tượng lừa đảo thường tìm kiếm, thu thập thông tin cá nhân, hình ảnh, video có giọng nói được đăng tải công khai trên các nền tảng mạng xã hội… rồi sử dụng công nghệ Deepfake để tạo ra giọng nói, khuôn mặt, video rất khó phát hiện thật giả.

Chúng thường thực hiện cuộc gọi video để giả làm người thân vay tiền; giả làm con, cháu đang du học nước ngoài gọi điện cho người thân nhờ chuyển tiền đóng học phí; giả tạo các tình huống khẩn cấp như người thân bị tai nạn cần tiền gấp để cấp cứu...

Đặc điểm chung của các cuộc gọi video lừa đảo này thường có âm thanh, hình ảnh không rõ nét, tín hiệu chập chờn giống như trong khu vực sóng di động hoặc wifi yếu.

Chúng thường nhắm vào người già, người lớn tuổi, thường có ít kiến thức về công nghệ và khó phân biệt được giữa video thật và video giả.

Người đang trong tâm trạng tâm lý yếu, đang gặp phải các vấn đề về như stress, lo lắng… cũng dễ bị lừa bằng các thông tin giả mạo. Người có tài sản lớn, vị trí xã hội cao, người làm kinh doanh... là đối tượng dễ bị chú ý và có khả năng sập bẫy lừa đảo cao.

Trước phương thức, thủ đoạn trên, Bộ Công an khuyến cáo, người dân cảnh giác khi nhận bất kỳ tin nhắn, cuộc gọi video với nội dung vay, mượn tiền qua các ứng dụng mạng xã hội như: viber, zalo, facebook, telegram… cần xác minh, kiểm tra lại thông tin bằng cách gọi lại số điện thoại di động hoặc trao đổi trực tiếp với người thân.

Người dân hạn chế đăng tải các thông tin cá nhân, hình ảnh, video… của bản thân, người nhà tùy tiện lên mạng xã hội để tránh lộ, lọt thông tin cá nhân, người thân.

Trường hợp nghi vấn đối tượng giả mạo người thân, bạn bè, đồng nghiệp trên mạng xã hội lừa đảo, chiếm đoạt tài sản cần báo ngay cho cơ quan công an phường, thị trấn nơi gần nhất để được hỗ trợ, hướng dẫn xử lý....